軌道アトラクタモデルによる文脈に応じた連想

■ 文脈に応じた連想モデル

回帰型ニューラルネットの1つ軌道アトラクタモデルを用いて分散表現を基に連想を行うモデルのデモです.同じ入力パターンに対しても文脈パターンを切り替えることによってネットワークの状態遷移が様々に変わります.

動作

- 一つ一つのマスが素子を表しています.

- ある一つの素子は,他の全ての素子から入力を受けて,それを加算し,ある非単調な関数を通して出力を出します.

- 各素子は非同期的に動作し,入力に応じて正または負(白黒で表示)の二つの状態をとることが出来ます.

- 情報は素子の活動パターンとして表現され,徐々に状態があるパターンから別のパターンへ連続的に変化します(一定期周期でキャプチャした画面のため,やや不連続に見えますが,実際はマスの状態が一つ一つ変わります).

文脈情報の修飾

- 活動パターンの上に別のパターンが被せられています.

- これによって,素子の一部の出力が強制的に0(中立化)になります(マスの中央に点がこの操作を表します).

- このパターンが文脈情報を表す文脈パターンです.

参考文献

▼Morita, M. (1996a): Memory and learning of sequential patterns by nonmonotone neural networks, Neural Networks, 9, 1477-1489.

▼森田昌彦,松沢浩平,諸上茂光 (2002): 非単調神経素子の選択的不感化を用いた文脈依存的連想モデル, 電子情報通信学会論文誌(D-II), J85-D-II, 1602-1612.

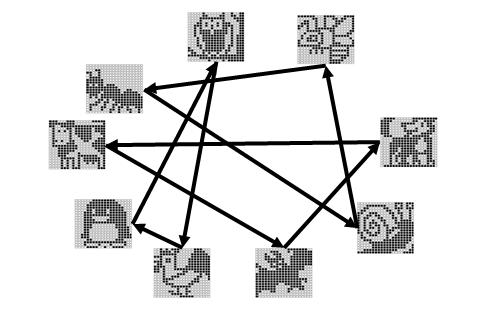

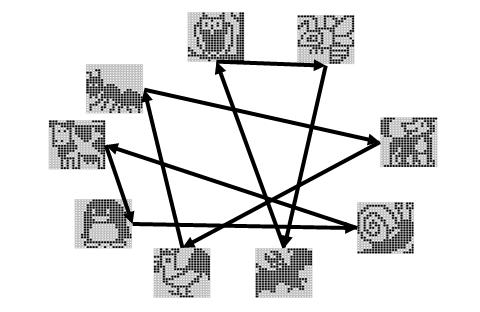

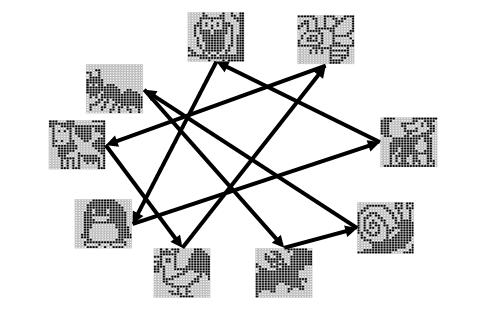

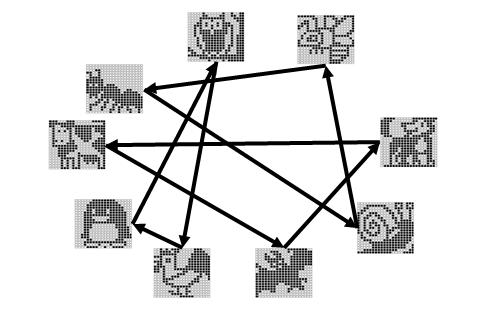

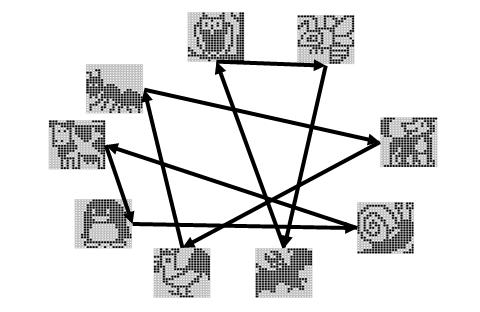

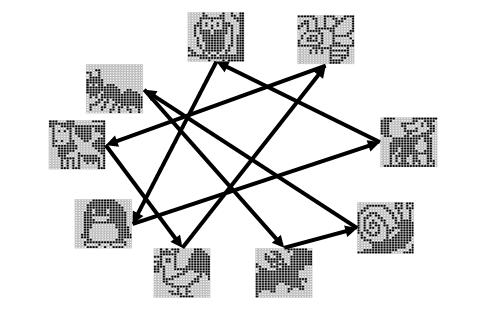

■ 各文脈において学習した系列と状態遷移の例

文脈1:分類が同じなのは?

文脈2:移動速度が似ているのは?

文脈3:人との親しさは?

■ 軌道アトラクタモデルの特徴と大きな可能性

- シンボル(もしくは局所表現)を用いずに,分散表現だけで大規模で任意の有限オートマトンが模擬できます.

- また,多数の素子の相互作用により力学系を構成するので,運動など連続的な状態遷移を記述することでき動的パターン処理が可能になります.

- さらに,入力情報も文脈情報も全てがパターンとして分散表現されているため,パターンの類似性に基づいた強力な類推能力が期待されます.

各種デモンストレーションのページへ